Fuente: Nature Medicine

La inteligencia artificial en la primera línea de la medicina: El caso de DeepSeek

La integración de la inteligencia artificial (IA) en el ámbito médico ha dejado de ser una promesa futurista para convertirse en una realidad tangible, especialmente en China, donde el modelo de lenguaje de gran escala DeepSeek está siendo implementado rápidamente en hospitales. Un artículo publicado en Nature Medicine analiza este fenómeno, destacando cómo la capacidad de DeepSeek para operar localmente en las instalaciones hospitalarias está transformando la atención médica, al tiempo que expone un vacío regulatorio que exige atención inmediata. En un mundo donde la tecnología avanza a un ritmo vertiginoso, la adopción de herramientas de IA como DeepSeek plantea una pregunta crucial: ¿cómo equilibrar la innovación con la seguridad y la ética en un entorno tan crítico como el sanitario?

El contexto actual hace que esta pregunta sea particularmente relevante. La pandemia de COVID-19 y el envejecimiento de la población global han puesto bajo presión los sistemas de salud, exigiendo soluciones que optimicen los recursos y mejoren los resultados clínicos. En China, donde la digitalización de la atención médica está avanzando rápidamente, DeepSeek promete agilizar procesos como el diagnóstico, la gestión de datos y la interacción con pacientes. Sin embargo, su implementación plantea desafíos regulatorios, éticos y técnicos que no pueden ser ignorados. Este artículo explora cómo DeepSeek está redefiniendo la medicina moderna y por qué la falta de un marco regulatorio claro podría limitar su potencial o, peor aún, generar riesgos imprevistos.

DeepSeek: Un aliado digital en los hospitales

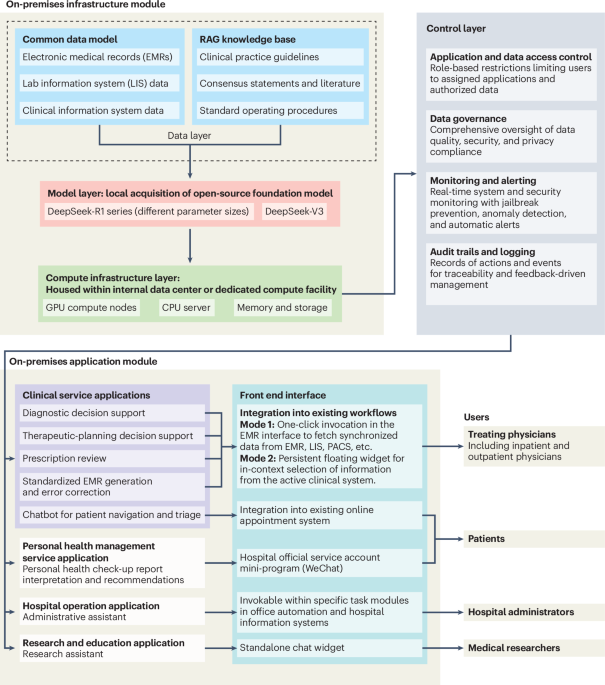

DeepSeek es un modelo de lenguaje de gran escala diseñado para procesar y generar texto en contextos complejos, con aplicaciones que van desde la traducción automática hasta el análisis de datos clínicos. A diferencia de otros modelos de IA que dependen de la nube, DeepSeek puede implementarse localmente en los servidores de un hospital, lo que permite un procesamiento rápido y seguro de datos sensibles sin necesidad de conexión constante a internet. Esta característica es especialmente valiosa en el entorno médico, donde la privacidad de los datos y la rapidez en la toma de decisiones son fundamentales.

El artículo describe un ejemplo concreto: en el Hospital P de Pekín, DeepSeek se ha integrado en el sistema de consultas ambulatorias (OPD, por sus siglas en inglés). Allí, el modelo asiste a los médicos en tareas como la transcripción automática de consultas, la generación de informes clínicos y la sugerencia de diagnósticos basados en los síntomas reportados por los pacientes. Este enfoque no solo reduce la carga administrativa de los profesionales de la salud, sino que también mejora la precisión y la eficiencia en la atención al paciente. Por ejemplo, DeepSeek puede analizar historias clínicas electrónicas y proponer hipótesis diagnósticas en cuestión de segundos, un proceso que podría tomar mucho más tiempo a un médico humano.

El estudio destaca que la implementación de DeepSeek se llevó a cabo con una rapidez sorprendente, lo que refleja tanto el entusiasmo por la IA en el sector sanitario chino como la falta de barreras regulatorias estrictas. Sin embargo, esta velocidad también ha revelado un “área gris” en la regulación, ya que los marcos legales actuales no están completamente adaptados para supervisar el uso de modelos de IA en entornos clínicos.

Un vacío regulatorio que exige acción

El núcleo del artículo radica en la necesidad de una respuesta regulatoria que acompañe el despliegue de DeepSeek. Aunque la capacidad de la IA para mejorar la atención médica es innegable, su uso plantea riesgos significativos. Por ejemplo, ¿cómo garantizar que las recomendaciones de DeepSeek sean precisas y seguras? ¿Qué sucede si el modelo comete un error en un diagnóstico crítico? Además, la privacidad de los datos es una preocupación central, especialmente en un contexto donde los hospitales manejan información altamente sensible. Aunque DeepSeek opera localmente, la posibilidad de filtraciones de datos o mal uso de la tecnología sigue siendo un riesgo.

Para abordar estas cuestiones, los autores proponen la creación de un marco regulatorio específico que contemple varios aspectos clave. En primer lugar, se necesitan directrices claras sobre la validación clínica de los modelos de IA, similares a las que se aplican a los dispositivos médicos tradicionales. Esto implicaría pruebas rigurosas para evaluar la precisión, la seguridad y la eficacia de DeepSeek en diferentes contextos clínicos. En segundo lugar, se deben establecer protocolos para proteger la privacidad de los datos, asegurando que los sistemas de IA cumplan con estándares internacionales como el Reglamento General de Protección de Datos (GDPR) de la Unión Europea. Finalmente, es crucial definir responsabilidades claras en caso de errores, para determinar si la responsabilidad recae en los desarrolladores del modelo, los hospitales o los médicos que lo utilizan.

Resultados preliminares y su impacto

Aunque el artículo no presenta datos cuantitativos detallados sobre el desempeño de DeepSeek, cita ejemplos cualitativos que ilustran su potencial. En el Hospital P, por ejemplo, los médicos reportaron una reducción significativa en el tiempo necesario para completar tareas administrativas, lo que les permitió dedicar más tiempo a la atención directa de los pacientes. Además, las sugerencias diagnósticas de DeepSeek han demostrado ser útiles en casos complejos, donde la integración de grandes volúmenes de datos clínicos es un desafío para los profesionales humanos.

Sin embargo, los autores advierten que estos beneficios deben equilibrarse con una supervisión cuidadosa. Los modelos de lenguaje como DeepSeek, aunque avanzados, no son infalibles. Pueden generar respuestas plausibles pero incorrectas, un fenómeno conocido como “alucinación” en la IA. En un entorno médico, estas alucinaciones podrían tener consecuencias graves, desde diagnósticos erróneos hasta tratamientos inadecuados. Por esta razón, el artículo enfatiza que DeepSeek debe ser visto como una herramienta de apoyo, no como un reemplazo de la experiencia clínica humana.

Nuevos paradigmas y preguntas para el futuro

El despliegue de DeepSeek en hospitales chinos marca un punto de inflexión en la integración de la IA en la medicina. Este avance sugiere un futuro donde los sistemas de salud podrían operar con una eficiencia sin precedentes, utilizando la IA para analizar datos en tiempo real, personalizar tratamientos y mejorar la experiencia del paciente. Sin embargo, también plantea preguntas fundamentales sobre el papel de la tecnología en la medicina. ¿Hasta qué punto podemos confiar en la IA para tomar decisiones que afectan vidas humanas? ¿Cómo garantizar que la adopción de estas tecnologías no exacerbe las desigualdades en el acceso a la atención médica?

Un aspecto particularmente interesante es el potencial de DeepSeek para democratizar la atención médica en regiones con recursos limitados. Al operar localmente, el modelo podría implementarse en hospitales rurales o de bajos ingresos, donde la escasez de especialistas es un problema común. Sin embargo, esto requerirá no solo avances tecnológicos, sino también políticas que promuevan la equidad en el acceso a la IA. En este sentido, el caso de DeepSeek podría servir como un modelo para otros países que buscan integrar la IA en sus sistemas de salud.

Otra pregunta abierta es cómo evolucionará la relación entre médicos y máquinas. A medida que herramientas como DeepSeek se vuelven más comunes, los profesionales de la salud necesitarán nuevas habilidades para trabajar junto a la IA, desde interpretar sus recomendaciones hasta identificar sus limitaciones. Esto podría transformar la educación médica, incorporando la alfabetización en IA como una competencia esencial.

Contexto y analogías: La IA como un nuevo estetoscopio

Para comprender el impacto de DeepSeek, es útil compararlo con otras innovaciones que han transformado la medicina. Hace dos siglos, el estetoscopio revolucionó el diagnóstico al permitir a los médicos escuchar los sonidos internos del cuerpo de manera no invasiva. De manera similar, DeepSeek actúa como una herramienta que amplifica las capacidades de los médicos, permitiéndoles “escuchar” patrones en datos clínicos que de otro modo serían difíciles de detectar. Sin embargo, al igual que el estetoscopio, la IA requiere un usuario capacitado para interpretar sus resultados y aplicarlos correctamente.

El caso de DeepSeek también se enmarca en una tendencia más amplia de digitalización en la atención médica. En los últimos años, hemos visto avances como el uso de IA para predecir brotes de enfermedades, optimizar ensayos clínicos y personalizar tratamientos oncológicos. DeepSeek lleva esta tendencia un paso más allá al integrarse directamente en los flujos de trabajo clínicos, demostrando que la IA puede ser más que una herramienta de investigación: puede ser un compañero en la práctica diaria.

Hacia un futuro regulado y responsable

El artículo de Nature Medicine nos deja con una certeza: la IA, representada por modelos como DeepSeek, tiene el potencial de transformar la atención médica, pero su éxito dependerá de nuestra capacidad para regularla de manera efectiva. En China, donde la adopción de la IA está avanzando rápidamente, el caso de DeepSeek sirve como un recordatorio de que la innovación debe ir de la mano con la responsabilidad. Un marco regulatorio claro no solo protegerá a los pacientes, sino que también fomentará la confianza en estas tecnologías, allanando el camino para su adopción global.

En última instancia, DeepSeek no es solo una herramienta tecnológica, sino un reflejo de los desafíos y oportunidades que enfrenta la medicina moderna. Al abordar el vacío regulatorio y fomentar un diálogo entre científicos, médicos, reguladores y pacientes, podemos asegurarnos de que la IA cumpla su promesa de mejorar la salud humana sin comprometer los principios éticos que sustentan la práctica médica.

Enlace a la fuente original: